L’intelligence artificielle (IA) a fait des progrès incroyables ces dernières années. Pourtant, comprendre ce qu’est une hallucination de l’IA et comment la surmonter reste un processus continu pour les créateurs de LLM.

La technologie d’aujourd’hui et de demain continue de nous fasciner tous, notamment en ce qui concerne la manière dont l’IA peut comprendre et générer le langage humain. D’énormes progrès ont été réalisés grâce aux grands modèles linguistiques (LLM), des programmes informatiques formés sur d’énormes quantités de texte. Ces LLM peuvent écrire différents types de formats de texte créatifs, comme des poèmes, du code, des scripts, des pièces musicales, des courriers électroniques, des lettres, etc.

Cependant, la puissance de ces modèles impressionnants pose un problème particulier : ils « hallucinent » parfois.

Qu’est-ce qu’une hallucination IA ?

Tout comme les humains peuvent imaginer ou imaginer des choses qui ne sont pas réelles, l’IA peut faire quelque chose de similaire. Les hallucinations de l’IA se produisent lorsqu’un LLM produit un texte qui semble crédible mais qui est factuellement faux. Ces hallucinations peuvent aller d’erreurs mineures à des histoires complètement inventées et à des déclarations absurdes.

Pour mieux comprendre ce problème, regardons quelques exemples :

- Mélanger les faits: Une IA chargée d’écrire un article d’actualité sur un événement peut inclure des dates et des lieux incorrects, ou déformer les personnes impliquées.

- Créer du faux information : Une IA chargée de rédiger une description de produit pourrait inventer des fonctionnalités que le produit ne possède pas réellement.

- En toute confiance incorrect: Ce qui est vraiment délicat avec les hallucinations de l’IA, c’est qu’elles sont souvent présentées de manière très convaincante, ce qui rend difficile de les distinguer des informations réelles.

Pourquoi les hallucinations sont un problème pour les LLM ?

Comme vous pouvez le voir dans nos explications sur ce qu’est une hallucination de l’IA, elles constituent un problème important pour les LLM pour plusieurs raisons. Premièrement, si les gens ne peuvent pas faire confiance au texte généré par un LLM, les utilisateurs perdent confiance dans l’utilité et la fiabilité globales de la technologie. Imaginez que vous lisez un résumé en ligne d’un article d’actualité rédigé par un LLM. Si le résumé contient des erreurs factuelles, vous pourriez cesser complètement d’utiliser cette source. Cela peut constituer un problème majeur pour toute application qui s’appuie sur des LLM pour générer du texte, comme les chatbots, les assistants virtuels ou les outils de création de contenu automatisés.

Deuxièmement, les hallucinations de l’IA pourraient contribuer à la propagation de fausses informations. À une époque où les fausses nouvelles constituent déjà une préoccupation majeure, un texte généré par l’IA qui semble crédible pourrait facilement être confondu avec de vraies informations. Cela pourrait avoir un impact négatif sur tout, du discours public aux processus décisionnels importants. Par exemple, imaginez un LLM créant des publications sur les réseaux sociaux sur un candidat politique contenant de fausses informations.

Ces messages pourraient induire les électeurs en erreur et influencer le résultat d’une élection. C’est exactement la raison pour laquelle Google a désactivé la capacité de Gemini à répondre aux requêtes liées aux élections.

Troisièmement, les entreprises ou organisations qui utilisent les LLM pourraient subir une atteinte à leur réputation si leurs systèmes d’IA produisent du contenu inexact ou préjudiciable. Disons qu’une entreprise utilise un LLM pour rédiger des descriptions de produits pour sa boutique en ligne. Si le LLM invente des fonctionnalités que les produits n’ont pas réellement, cela pourrait entraîner le mécontentement des clients et nuire à la réputation de l’entreprise.

Pourquoi les hallucinations de l’IA se produisent-elles ?

Vous avez actuellement quelques idées sur ce qu’est une hallucination de l’IA, mais pourquoi se produisent-elles ? Plusieurs facteurs contribuent à ce problème :

- Comment ils sont formés: Les LLM reçoivent d’énormes quantités de données textuelles. Ces données contiennent souvent des erreurs, des biais et des informations obsolètes. L’IA apprend de ces données tout comme elle le fait d’informations correctes.

- Comprendre vs créer: Les LLM sont bons pour comprendre les modèles du langage, mais ils n’ont pas toujours une solide compréhension des concepts ou de la logique du monde réel. Ils peuvent générer quelque chose qui semble plausible sans que cela soit réellement vrai.

- La quête de la fluidité: Les LLM sont conçus pour produire un texte qui semble naturel et humain. Parfois, cela signifie « combler les lacunes » là où il peut y avoir des lacunes dans les connaissances de l’IA. Ces espaces vides peuvent amener l’IA à créer du contenu.

Que fait-on pour résoudre ce problème ?

Les chercheurs et les développeurs de la communauté de l’IA travaillent activement sur les moyens de réduire les hallucinations liées à l’IA.

Certaines des approches comprennent :

- De meilleures données d’entraînement: Créer des ensembles de données soigneusement sélectionnés, moins susceptibles de contenir des erreurs et des biais, conduisant à un meilleur comportement de l’IA.

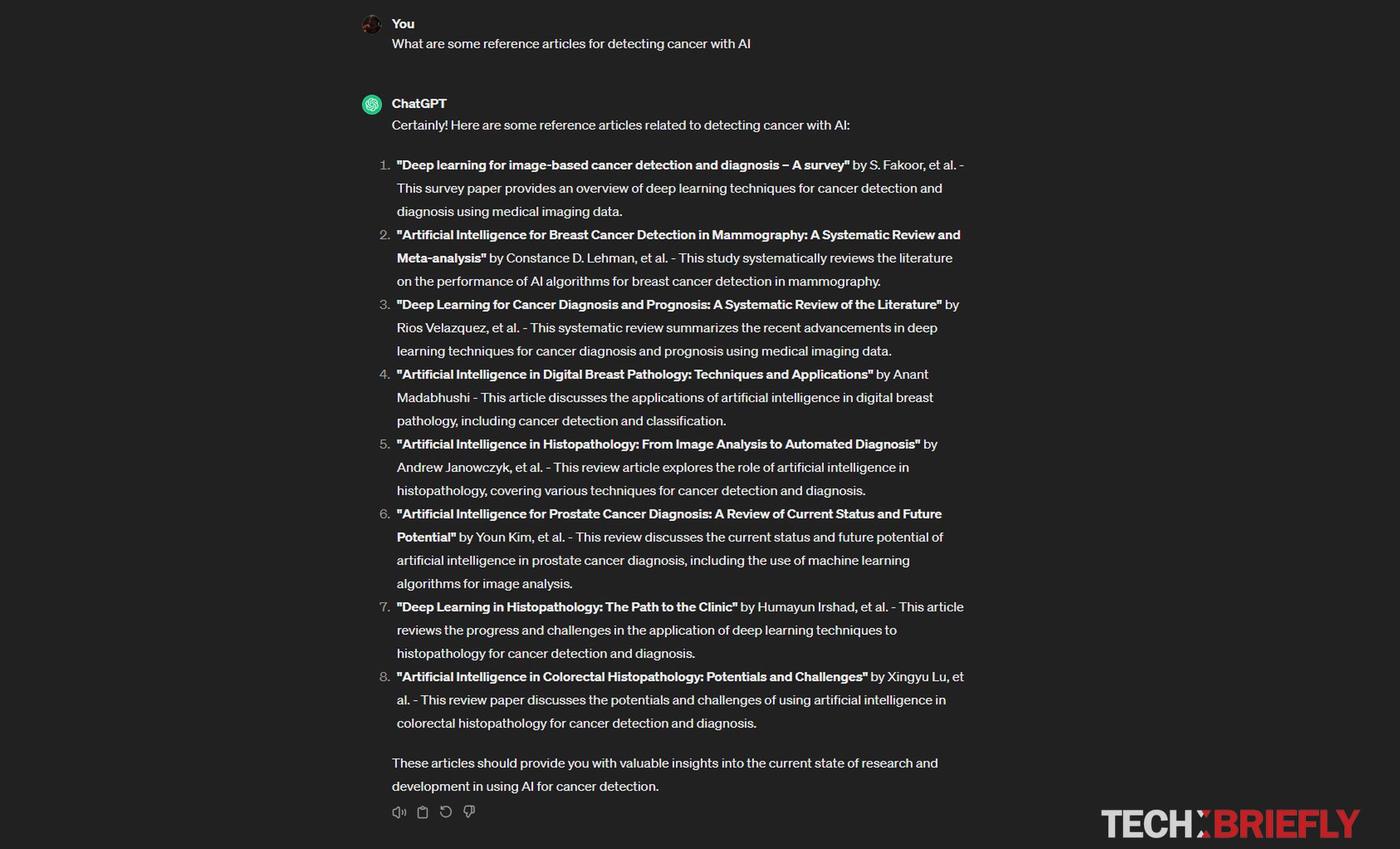

- Vérification des faits: Développer des techniques pour croiser le texte généré par l’IA avec des sources fiables, garantissant ainsi son exactitude.

- Explicabilité: Concevoir des LLM capables d’expliquer leur processus de raisonnement, ce qui facilite la détection des erreurs potentielles

- Collaboration homme-IA: Construire des systèmes où les humains et l’IA travaillent ensemble, facilitant l’identification et la correction des hallucinations.

En plus de tout cela, Jensen Huang de Nvidia affirme que les hallucinations liées à l’IA peuvent être guéries dans les 5 prochaines années.

Les hallucinations de l’IA constituent donc un défi complexe, mais crucial à relever si les LLM veulent atteindre leur plein potentiel. À mesure que les technologies permettant de réduire les hallucinations deviennent plus sophistiquées, elles promettent de faire des LLM un outil beaucoup plus fiable et précieux pour les tâches de communication, de créativité et de connaissances.

Crédit image en vedette: vackground.com/Unsplash

Source: Qu’est-ce qu’une hallucination de l’IA et pourquoi est-ce si important pour l’avenir des LLM ?