Microsoft a deployé un nouveau développement passionnant dans le domaine des modèles de langage : le LLM 1 bit. Cet avancement, inspiré par des projets de recherche comme BitNet, marque un changement notable dans la manière dont les modèles de langage sont construits et optimisés. Au cœur de cette innovation se trouve une méthode étonnamment efficace de représentation des paramètres (ou pondérations) du modèle.en utilisant seulement 1,58 bits, par opposition à la virgule flottante traditionnelle de 16 bits (FP16) approche prédominante dans les modèles précédents.

Le premier LLM 1 bit en son genre

Doublé BitNet LLM b1.58cette approche pionnière limite les valeurs potentielles de chaque poids à seulement trois options : -1, 0 ou +1. Cette réduction spectaculaire du nombre de bits requis par paramètre constitue la base de cette technologie révolutionnaire. Étonnamment, malgré sa faible consommation de bits, BitNet b1.58 parvient à fournir des mesures de performances comparables à celles des modèles traditionnels. Cela inclut des domaines tels que la perplexité et la performance des tâches finales, tout en utilisant la même taille et les mêmes ensembles de données de formation.

Que sont les LLM 1 bit ?

La scène de l’IA générative évolue de jour en jour, et la dernière avancée dans ce domaine dynamique est l’avènement des modèles d’apprentissage des langues 1 bit. Cela peut paraître surprenant, mais ce développement a le potentiel de transformer le domaine de l’IA en abordant certains des obstacles les plus importants auxquels sont confrontés les LLM aujourd’hui :à savoir, leur taille gargantuesque.

En règle générale, les poids d’un modèle d’apprentissage automatique, qu’il s’agisse d’un LLM ou de quelque chose d’aussi simple que la régression logistique, sont stockés à l’aide soit Virgules flottantes 32 bits ou 16 bits. Cette approche standard est une arme à double tranchant ; si cela permet une grande précision dans les calculs du modèle, cela se traduit également par la taille immense de ces modèles.

Cette surcharge est précisément la raison pour laquelle le déploiement de champions lourds comme GPT sur des systèmes locaux ou dans des environnements de production devient un cauchemar logistique. Leur nombre astronomique de poids, rendu nécessaire par la précision de ces virgules flottantes, gonfle leur taille dans des proportions ingérables.

Contrairement aux modèles traditionnels, Les LLM 1 bit n’utilisent qu’un seul bit (0 ou 1) pour représenter les paramètres de poids. Cette modification apparemment mineure a des implications majeures : elle réduit considérablement la taille globale des modèles, potentiellement dans une large mesure.

Une telle réduction de taille ouvre la voie au déploiement de LLM sur des appareils beaucoup plus petitsrendant les applications d’IA avancées plus accessible et réalisable sur un plus large éventail de plateformes.

Retour à BitNet LLM b1.58

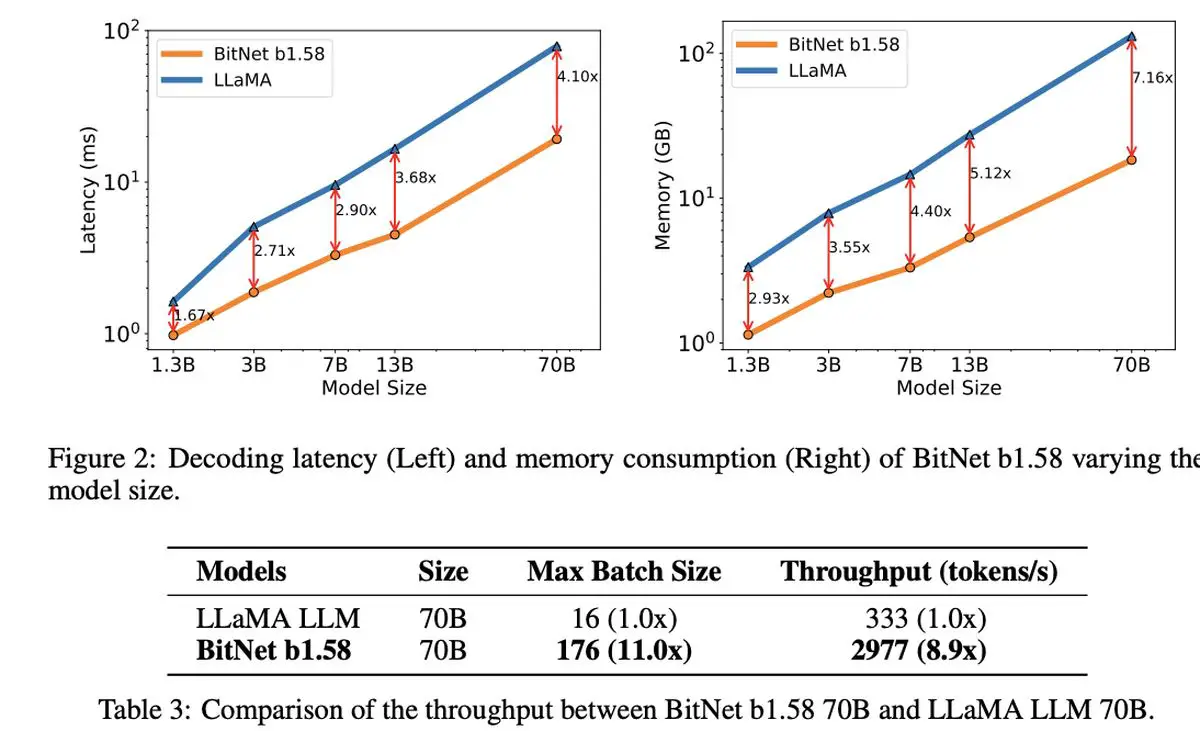

Ce qui est vraiment remarquable à propos du LLM 1,58 bits, c’est son rentabilité. Le modèle brille en termes de latence réduite, d’utilisation moindre de la mémoire, de débit amélioré et de consommation d’énergie réduite, présentant ainsi une option durable dans le monde intensif en calcul de l’IA.

Le LLM 1 bit de Microsoft ne se distingue pas seulement par son efficacité. Il représente une nouvelle perspective sur la mise à l’échelle et la formation des modèles linguistiques, en équilibrant performances de premier ordre et viabilité économique. Cela fait allusion à l’aube de nouveaux paradigmes informatiques et à la possibilité de créer du matériel spécialisé adapté pour exécuter ces modèles plus simples et plus efficaces.

La discussion autour de BitNet LLM b1.58 s’ouvre également des possibilités intrigantes pour gérer plus efficacement les longues séquences dans les LLMsuggérant des domaines potentiels pour des recherches plus approfondies dans les techniques de compression sans perte pour augmenter encore plus l’efficacité.

Dans l’ombre de cette innovation notable, Microsoft a également fait des vagues avec son dernier petit modèle de langage, Phi-2. Cette centrale de 2,7 milliards de paramètres a démontré des capacités exceptionnelles en matière de compréhension et de raisonnement, preuve supplémentaire de l’engagement continu de Microsoft à repousser les limites de la technologie de l’IA. L’introduction du LLM 1 bit, ainsi que le succès de Phi-2, mettraient en évidence une ère passionnante d’innovation et d’efficacité dans le développement de modèles de langage.

Crédit image en vedette : Drew Beamer/Unsplash

Source: Microsoft présente son LLM 1 bit