Les deepfakes sont utilisés à des fins très diverses, notamment dans le cadre de campagnes de désinformation, et il devient de plus en plus difficile de détecter ces images modifiées.

Comment cette IA détecte-t-elle les images Deepfake ?

Mais il existe un nouvel outil d’IA pour repérer ces fausses vidéos, il vérifie la lumière réfléchie dans les yeux.

Le projet a été créé par une équipe d’informaticiens de l’Université de Buffalo. Selon l’étude, cette nouvelle IA a pu détecter des images de portrait Deepfake avec un taux de réussite surprenant de 94%.

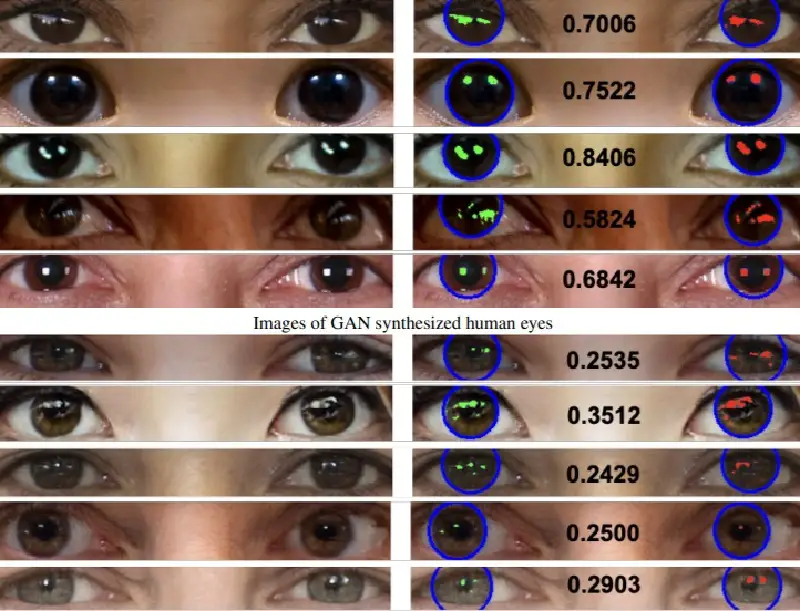

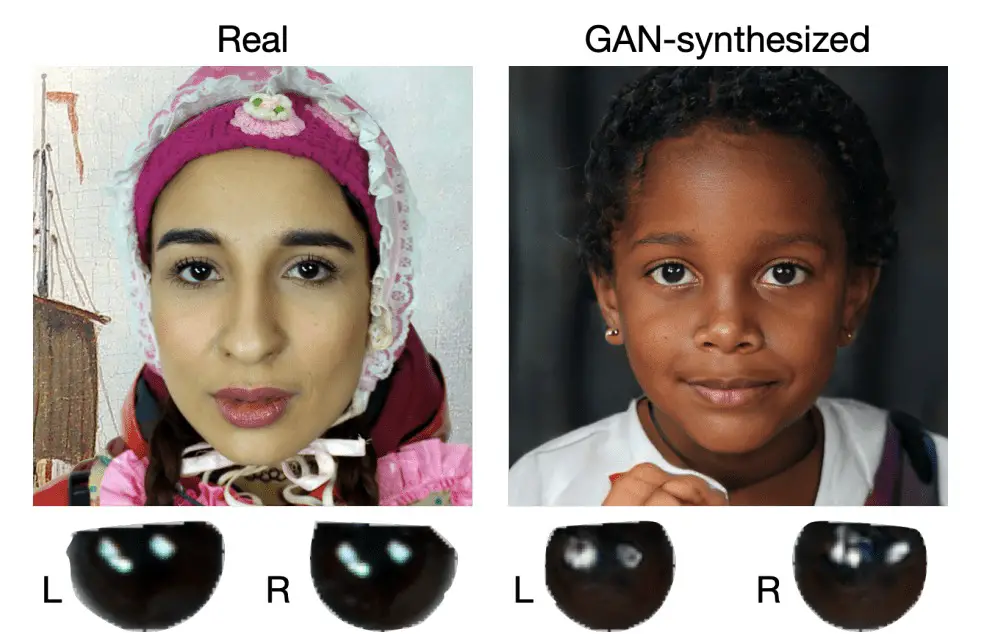

Le système expose les fausses images en analysant « les reflets spéculaires cornéens incohérents entre deux yeux ».

Lorsque nous prenons en photo un vrai visage, le reflet sur les deux yeux sera similaire. Parce qu’ils voient la même chose. Mais généralement, les images Deepfake ne parviennent pas à capturer avec précision cette ressemblance, et sont donc incapables de capturer la véritable ressemblance de la personne qu’elles tentent d’imiter.

Le système analyse l’image puis calcule un score qui est utilisé pour déterminer la similitude d’une personne à une autre.

L’inconvénient le plus évident de l’outil est qu’il nécessite une source de lumière réfléchie dans les deux yeux. Ces motifs peuvent être facilement corrigés à l’aide d’un post-traitement manuel et la méthode ne fonctionnera pas s’il manque un œil sur l’image.

Microsoft rachète Nuance, la société d’IA qui utilise Siri, pour 19,7 milliards de dollars

De plus, le système est susceptible de produire de faux résultats lorsque la personne sur la photo ne regarde pas la caméra.