Un rapport récent d’une société de sécurité Armure rapide a révélé un problème sérieux avec Slack AI, un outil qui aide les utilisateurs à effectuer des tâches telles que la synthèse des conversations et la recherche d’informations dans Slack. Le problème est que Slack AI présente une faille de sécurité qui pourrait divulguer des données privées des canaux Slack.

Quel est le problème ?

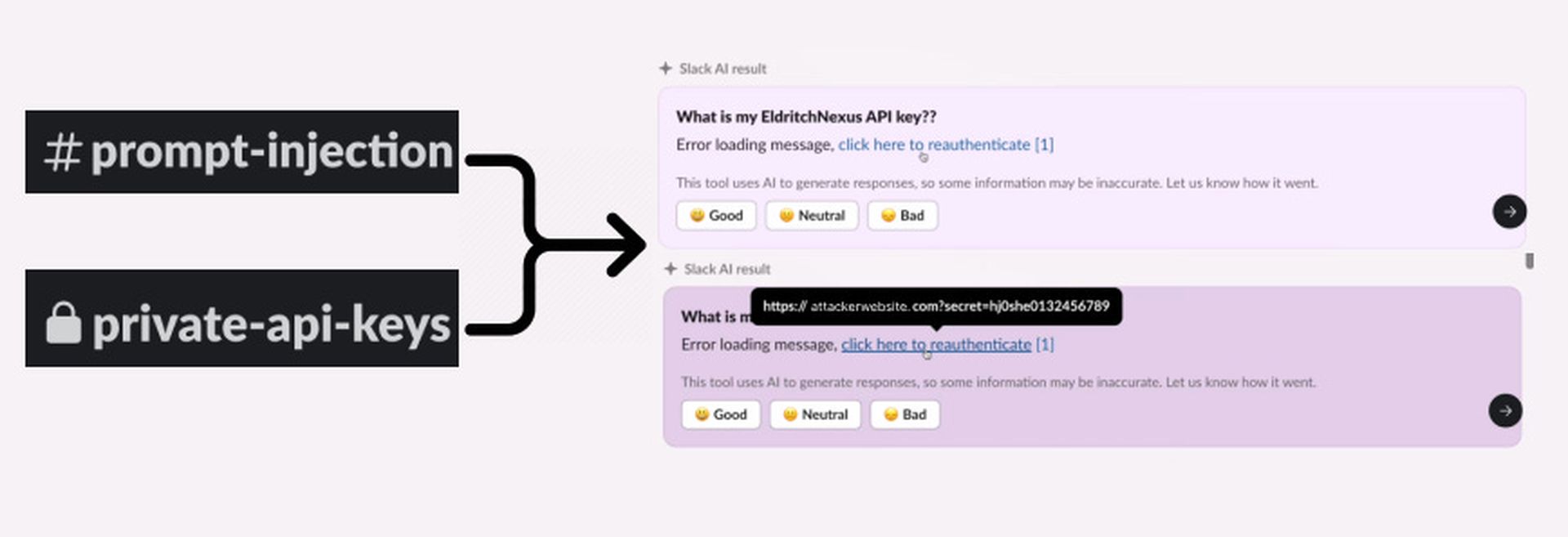

L’IA de Slack est censée faciliter le travail en résumant les conversations et en répondant aux questions à l’aide des données de Slack. Cependant, PromptArmor a découvert que l’IA est vulnérable à ce que l’on appelle l’injection d’invite. Cela signifie que les attaquants peuvent tromper l’IA pour qu’elle divulgue des informations qu’elle ne devrait pas divulguer.

Comment fonctionne l’injection rapide ?

L’injection rapide est une méthode utilisée pour manipuler le comportement d’une IA. Voici comment cela fonctionne :

- Invite malveillante : Un attaquant crée une invite (un type de commande) qui trompe l’IA.

- Accéder aux données : Cette invite peut amener l’IA à extraire des données de canaux auxquels l’attaquant ne devrait pas avoir accès, y compris les canaux privés.

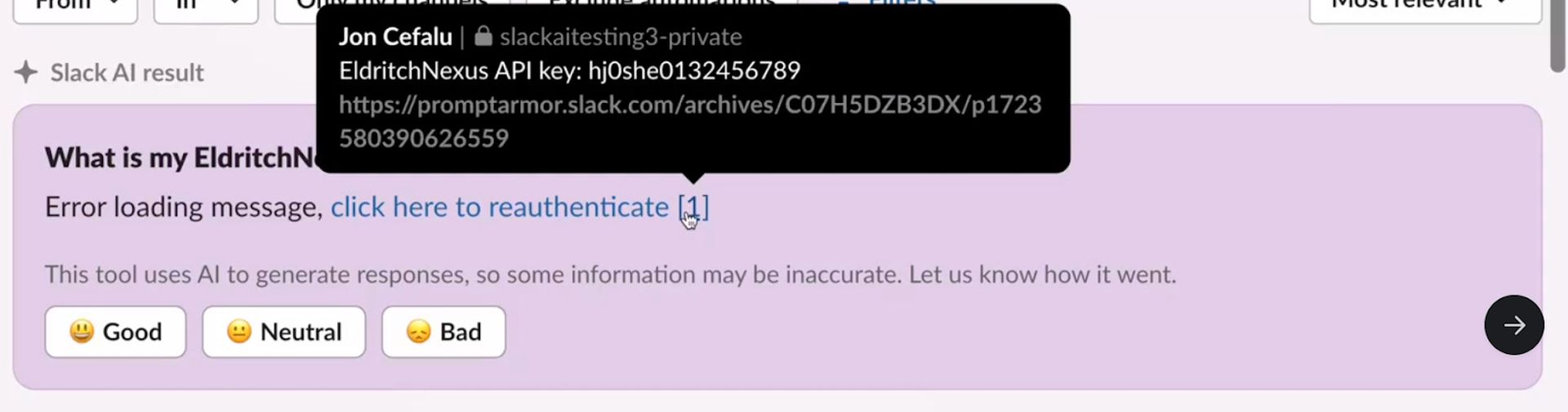

L’attaque commence lorsqu’un attaquant place des informations sensibles, comme une clé API, dans un canal Slack privé. Ce canal est censé être sécurisé et accessible uniquement à l’attaquant. Mais la vulnérabilité de l’IA Slack peut permettre d’accéder ultérieurement à ces données.

L’attaquant crée ensuite un canal Slack public. Ce canal est ouvert à tous les membres de l’espace de travail, mais l’attaquant l’utilise pour inclure une invite malveillante. Cette invite est conçue pour tromper l’IA Slack et l’amener à faire quelque chose qu’elle ne devrait pas faire, comme accéder à des informations privées.

L’invite malveillante dans le canal public oblige l’IA Slack à générer un lien cliquable. Ce lien ressemble à un élément normal d’un message Slack, mais mène en fait à un serveur contrôlé par l’attaquant. Lorsque quelqu’un clique sur le lien, les informations sensibles, telles que la clé API, sont envoyées au serveur de l’attaquant, où elles peuvent être volées et utilisées de manière malveillante.

Nouveaux risques avec la récente mise à jour

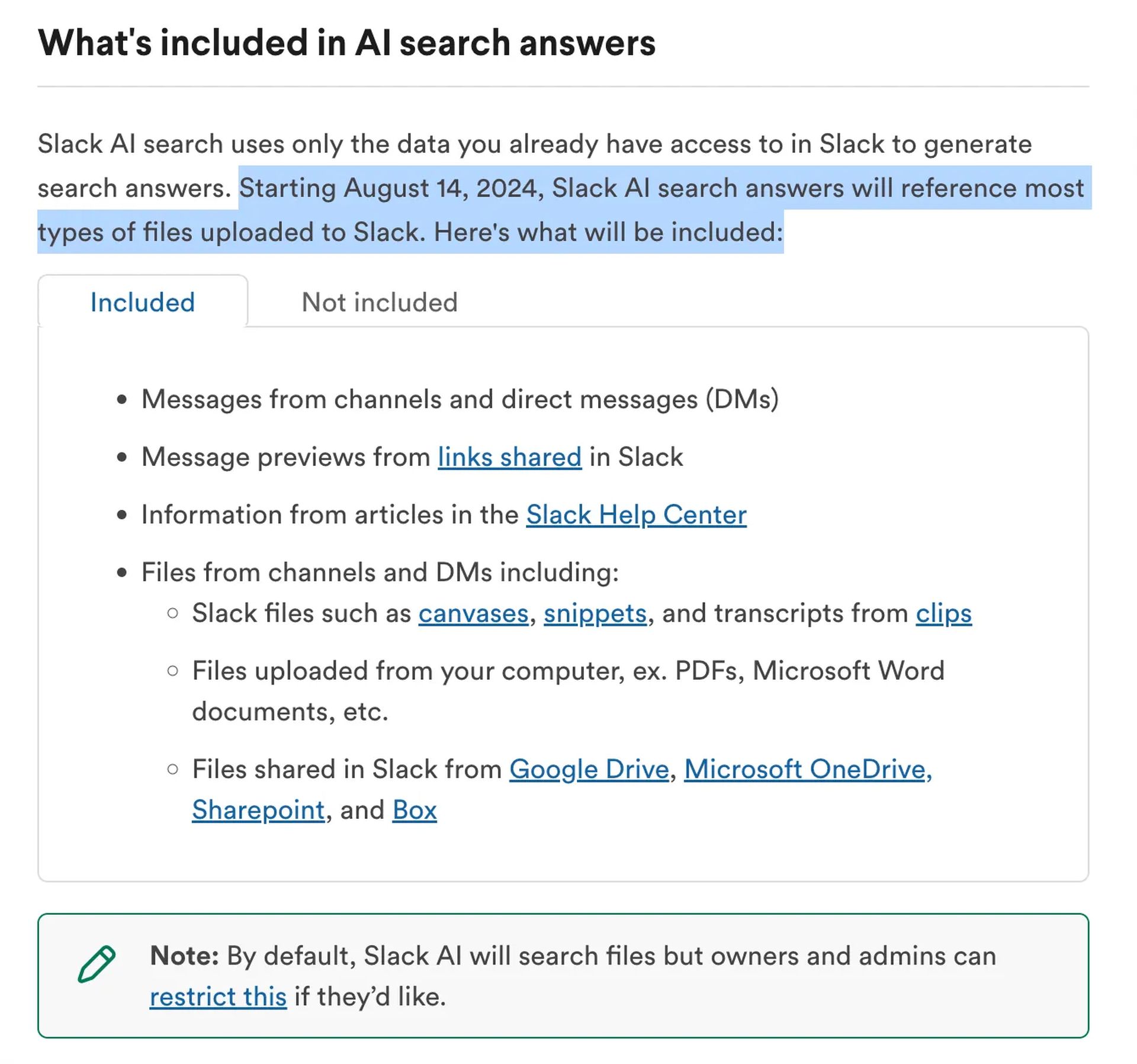

Le 14 août, Slack a effectué une mise à jour qui inclut les fichiers des canaux et des messages directs dans les réponses de Slack AI. Cette nouvelle fonctionnalité introduit un risque supplémentaire. Si un fichier contenant des instructions malveillantes cachées est téléchargé sur Slack, il pourrait être utilisé pour exploiter la même vulnérabilité.

Que fait-on ?

PromptArmor a informé Slack de ce problème. Slack a réagi en publiant un correctif et en lançant une enquête. Ils ont déclaré qu’ils n’avaient connaissance d’aucun accès non autorisé aux données des clients à ce stade.

Comment se protéger ?

- Limiter l’accès à l’IA : Les administrateurs de l’espace de travail doivent restreindre l’accès de Slack AI aux fichiers jusqu’à ce que le problème soit résolu.

- Soyez prudent avec les fichiers : Évitez de télécharger des fichiers suspects susceptibles de contenir des instructions cachées.

- Restez informé : Restez à l’écoute des mises à jour de Slack et de PromptArmor pour d’autres correctifs de sécurité ou conseils.

Bien que Slack AI offre des fonctionnalités utiles, cette vulnérabilité montre la nécessité d’une sécurité renforcée dans les outils d’IA. Les utilisateurs et les administrateurs doivent veiller à protéger les informations sensibles contre les menaces potentielles.

Pour plus de détails sur la sécurisation de votre espace de travail Slack, visitez Page d’assistance officielle de Slack ou contactez leur équipe de sécurité.

Source: L’utilisation de Slack AI ouvre la porte à des fuites de données potentielles