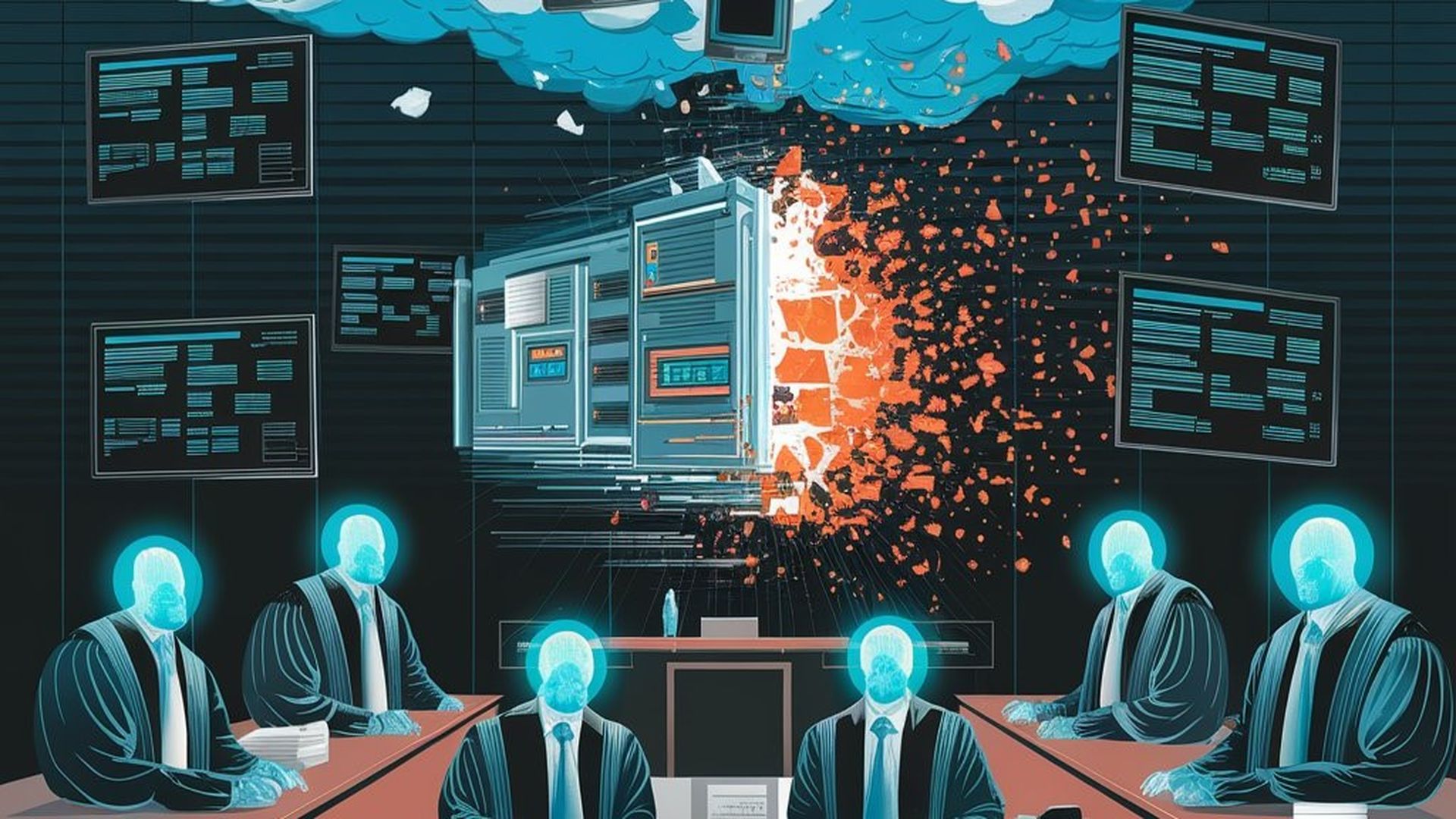

Récemment, nous avons été témoins du pouvoir de l’IA sur les réseaux sociaux pour identifier et supprimer les contenus malveillants, et apparemment, LinkedIn suit Facebook, Twitter et Pinterest dans ce cas.

Comment l’IA détecte-t-elle et supprime-t-elle le contenu inapproprié de LinkedIn?

UNE Publier publié aujourd’hui sur le blog de la plateforme appartenant à Microsoft explique comment LinkedIn trouve et supprime les publications à l’aide de l’intelligence artificielle. L’ingénieur logiciel Daniel Gorham raconte qu’avant de confier le poste à l’IA, LinkedIn a utilisé une liste de blocage, qui comprenait des mots et des phrases sélectionnés par des humains qui définiraient la faute. Mais bien sûr, il a fallu un effort considérable pour identifier les faux positifs et supprimer le contenu ou les comptes qui sont réellement incorrects, puisque LinkedIn compte plus de 660 millions de membres et 303 millions d’utilisateurs actifs par mois. La liste a donc fonctionné dans une petite mesure.

Le billet de blog a détaillé comment l’entreprise traite désormais les profils avec du contenu inapproprié qui pourrait être des grossièretés, des publicités pour des services illégaux, etc. les profils signalaient auparavant un faux positif et incluaient ces profils dans la formation spécifiquement.

LinkedIn utilisera également les services de traduction de Microsoft pour éliminer les «mauvais» contenus dans d’autres langues.