Jeudi, Oprah Winfrey a parlé de l’IA. L’émission spéciale « L’IA et notre avenir » a réuni des invités comme Sam Altman, PDG d’OpenAI, Marques Brownlee, influenceur technologique, et Christopher Wray, directeur du FBI. Bill Gates a rejoint l’émission pour un segment sur l’impact de l’IA sur la société. L’émission a fait réfléchir les téléspectateurs sur ce que l’avenir réserve à l’IA.

Une conversation sur l’IA et notre avenir

Oprah a donné le ton de la soirée avec une réflexion sombre sur l’évolution rapide de l’intelligence artificielle. Elle a souligné que l’IA est en train de devenir un phénomène grand public, que le monde soit prêt ou non. « Nous sommes les créatures les plus adaptables de cette planète », a-t-elle déclaré.Nous nous adapterons à nouveau, mais gardons un œil sur la réalité. Les enjeux ne pourraient pas être plus élevés.« Il était clair dès le début que ce discours n’avait pas pour but de célébrer les avancées de l’IA. Il s’agissait plutôt de se pencher sur la manière de naviguer de manière responsable dans le territoire inexploré ouvert par l’IA.

Les propos d’Oprah Winfrey reflétant un sentiment d’inquiétude partagé, l’émission a évolué vers des discussions plus approfondies avec des invités clés tels que Sam Altman et Bill Gates. Chacun d’eux a offert son point de vue sur l’état de l’IA et les défis à venir.

Sam Altman : équilibre entre le potentiel et les risques de l’IA

PDG d’OpenAI Sam Altman était le premier invité d’Oprah Winfrey et n’a pas perdu de temps pour se plonger dans les mécanismes de base de l’IA. Selon Altman, les systèmes d’IA actuels, y compris ChatGPT et le nouveau o1, sont conçus pour prédire les séquences de mots et, ce faisant, saisir les modèles et les concepts sous-jacents aux données. Mais tout le monde n’est pas d’accord avec le point de vue d’Altman. Alors qu’Altman présente l’IA comme apprendre des connexions plus profondes au sein des donnéesLes critiques soutiennent que l’IA se contente de suivre des modèles statistiques, sans vraiment les comprendre.

Malgré ses promesses excessives sur les capacités de l’IA actuelle, Altman a rapidement souligné la nécessité d’une intervention gouvernementale pour tester la sécurité des systèmes d’IA. Il a comparé la nécessité d’une réglementation de l’IA aux tests d’avions et de produits pharmaceutiques, soulignant que les risques que l’IA pose à la société nécessitent une attention particulière. Cependant, son plaidoyer en faveur de la réglementation a suscité un certain scepticisme étant donné l’opposition d’OpenAI à Projet de loi sur la sécurité de l’IA en Californie (SB 1047)qui a reçu le soutien de leaders de l’IA tels que Geoffrey Hinton.

Bien qu’Altman ait exprimé son optimisme, il a pris soin d’éviter les questions concernant son influence sur le développement de l’IA. Oprah lui a demandé pourquoi le public devrait lui faire confiance, mais Altman est resté vague, soulignant que la confiance est quelque chose qu’OpenAI vise à construire au fil du temps. non-réponse a attiré davantage l’attention lorsqu’Oprah a mentionné un titre qui le caractérisait comme «l’homme le plus puissant et le plus dangereux du mondeAltman n’est pas d’accord avec cette étiquette mais reconnaît que la direction de l’IA est une responsabilité qui pèse lourdement sur lui.

Qu’est-ce que le SB 1047 ?

Le projet de loi 1047 du Sénat de Californie (SB 1047) est une loi qui garantit que Les systèmes d’IA sont sûrsLe projet de loi, adopté en 2024, établit des exigences pour les développeurs d’IA, en particulier ceux qui créent des modèles complexes susceptibles de causer des dommages s’ils sont mal utilisés. Le SB 1047 exige que les développeurs ajoutent un «arrêt complet” fonctionnalité pour les systèmes d’IA. Cette fonctionnalité permet aux développeurs ou aux autorités d’arrêter un système d’IA s’il est dangereux, en particulier dans les secteurs sensibles comme la santé, la finance ou l’énergie. L’objectif est d’empêcher l’IA de causer des dommages dans des secteurs critiques.

Le projet de loi stipule également que les développeurs doivent créer des plans de sécurité pour que leurs modèles préviennent les dommages. Ces protocoles doivent inclure des mesures de protection contre les utilisations abusives, telles que les cyberattaques ou les armes. Ils doivent être révisés et mis à jour régulièrement pour rester à jour. Les développeurs doivent soumettre des versions expurgées de ces protocoles au procureur général de Californie. Le projet de loi SB 1047 met également l’accent sur l’évaluation des risques. Avant de publier un modèle d’IA, les développeurs doivent évaluer les risques et mettre en place les mesures de sécurité appropriées. Si un modèle est trop risqué, les développeurs ne peuvent pas le publier.

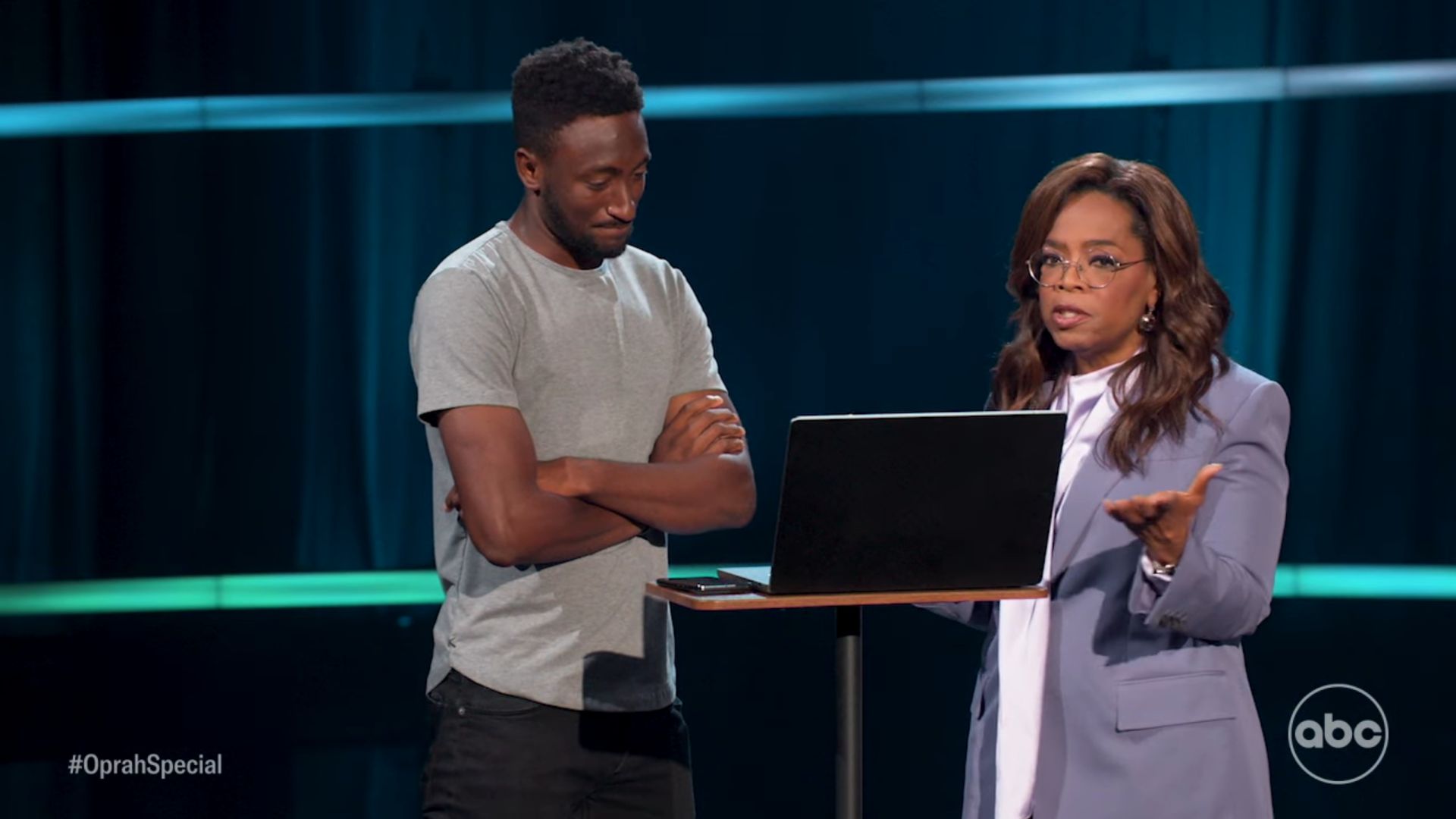

Une plongée en profondeur dans les Deepfakes

L’un des moments les plus effrayants de l’émission spéciale a eu lieu lorsque la discussion s’est tournée vers les Deepfakes, une technologie qui peut créer fausses vidéos hyperréalistes. Marques Brownleeconnu pour ses connaissances technologiques, a montré à quel point les vidéos générées par l’IA sont avancées. En présentant les capacités du nouveau générateur de vidéos Sora d’OpenAI, Brownlee a à la fois impressionné et rendu Oprah un peu nerveuse.

La démonstration de Brownlee a servi de tremplin à une conversation avec Le directeur du FBI, Christopher Wraydans lequel Wray a partagé ses expériences personnelles de rencontre avec des deep fakes produits par l’IA. Wray a décrit comment l’IA a été utilisée pour créer une vidéo de lui-même disant des choses qu’il n’a jamais dites, soulignant à quel point une telle technologie peut être persuasive et dangereuse. Wray a exprimé des inquiétudes croissantes quant à la manière dont l’IA est utilisée à des fins néfastes, en particulier dans des crimes tels que sextorsionqui a connu une forte augmentation avec l’utilisation de l’IA.

Wray n’a cependant pas été tout à fait pessimiste. Il a expliqué que même si les outils d’IA comme Deepfakes représentent de réelles menaces, la société a la responsabilité de rester vigilante et concentrée. Il a souligné la nécessité d’être particulièrement vigilante face à la désinformation qui circule à l’approche de l’élection présidentielle américaine. Selon Wray, le contenu trompeur de l’IA est pas un risque futur; elle est déjà là, affectant les interactions quotidiennes sur les réseaux sociaux. Les avertissements de Wray ont rappelé aux téléspectateurs le potentiel sombre de l’IA.

Bill Gates : La promesse de l’IA en médecine et en éducation

Tous les épisodes n’ont pas été aussi tendus. Oprah Winfrey s’est tournée vers le fondateur de Microsoft, Bill Gates, pour lui donner une perspective plus optimiste. Bill Gates soutient depuis longtemps que la technologie est une force du bien, et l’IA ne fait pas exception. Il a partagé son espoir que l’IA révolutionnera des domaines tels que la santé et l’éducation, en apportant une plus grande efficacité et en améliorant l’expérience humaine.

Gates a peint un image pleine d’espoirnotamment lors des rendez-vous médicaux, où l’IA pourrait jouer le rôle de tierce partie de soutien. « Au lieu de regarder un écran d’ordinateur, le médecin interagit avec vous et le logiciel s’assure que la transcription est vraiment bonne », a-t-il expliqué. La vision de Gates de l’IA est celle dans laquelle la technologie améliore plutôt qu’elle ne diminue l’interaction humaine. Mais même l’optimisme de Gates ne pouvait échapper aux réalités des limites de l’IA, car les préoccupations concernant les préjugés et l’éducation inappropriée passaient au second plan.

La vision du géant de la technologie s’étend à la salle de classe, où Gates décrit l’IA comme un enseignant personnalisé, toujours disponible et capable de s’adapter aux besoins d’apprentissage individuels. Cependant, Gates a ignoré les préoccupations croissantes concernant l’utilisation abusive de l’IA dans les établissements d’enseignement. Bien que l’IA ait un énorme potentiel pour améliorer l’apprentissage, les craintes de plagiat et de désinformation ont conduit de nombreux les écoles doivent adopter une approche prudente.

L’impact continu et sociétal de l’IA

À la fin du programme spécial, le thème général est devenu clair : l’IA se développe plus vite que la société ne peut l’imaginer. Si l’IA promet des avancées incroyables dans des domaines tels que la médecine et l’éducation, les risques qu’elle comporte sont tout aussi importants. De la fraude profonde à la désinformation, l’utilisation abusive de l’IA pose des dilemmes éthiques qui n’ont pas encore été résolus.

L’émission spéciale d’Oprah Winfrey n’a pas apporté toutes les réponses, mais elle a ouvert la voie à de nouvelles discussions sur la manière dont l’humanité peut faire face aux progrès rapides de l’IA. Des personnalités comme Sam Altman et Bill Gates ont peut-être des approches différentes, mais ils sont tous deux d’accord sur une chose : l’IA est là pour rester, et la gestion de son impact nécessitera une réflexion et une collaboration minutieuses.

Le mélange caractéristique de curiosité et d’optimisme prudent d’Oprah a laissé le public avec plus de questions que de réponses, mais c’était peut-être là le but. Dans un monde où la technologie continue de devancer la réglementation et la compréhension, il ne s’agit pas de connaître tous les faits immédiatement, mais d’être impliqué et informé.

Crédits images : ABC / YouTube

Source: Extraits de l’émission spéciale sur l’IA avec Oprah, Sam Altman et Bill Gates