L’IA Google DreamBooth est là. Les technologies récemment publiées comme DALL-E 2 d’OpenAI ou Stable Diffusion et Midjourney de StabilityAI prennent déjà d’assaut Internet. Il est maintenant temps de personnaliser les résultats. Mais comment ? L’Université de Boston et Google ont fourni les réponses, et nous les avons détaillées pour vous.

DreamBooth a la capacité de reconnaître le sujet d’une image, de la déconstruire de son contexte d’origine, puis de la synthétiser avec précision dans un nouveau contexte souhaité. De plus, il peut être utilisé avec les générateurs d’images AI actuels. Apprenez-en plus sur l’imagination alimentée par l’IA en poursuivant votre lecture.

Google DreamBooth AI expliqué

Google a dévoilé DreamBooth, un nouveau modèle de diffusion texte-image. Google DreamBooth AI peut créer une grande variété d’images du sujet choisi par un utilisateur dans diverses conditions en utilisant une invite textuelle comme instruction.

DreamBooth, une méthode révolutionnaire de modification de modèles texte-image fortement pré-entraînés, a été créée par une équipe de recherche de l’Université de Boston et de Google. Dans l’ensemble, l’idée est plutôt simple : ils veulent étendre le dictionnaire de vision du langage de sorte que les identifiants de jeton rares soient connectés à un sujet spécifique que l’utilisateur souhaite créer.

Fonctionnalités clés de Google DreamBooth AI :

- Avec 3 à 5 photos, DreamBooth AI peut améliorer un modèle texte-image.

- En utilisant DreamBooth AI, des images photoréalistes complètement originales du sujet peuvent être produites.

- De plus, le DreamBooth AI est capable de produire des images d’un sujet sous différentes perspectives.

L’objectif principal du modèle est de fournir aux utilisateurs les outils nécessaires pour créer des représentations photoréalistes des instances du sujet choisi et les connecter au modèle de diffusion texte-image. Par conséquent, cette méthode semble être efficace pour résumer les problèmes dans diverses circonstances.

DreamBooth de Google adopte une approche quelque peu différente des autres outils de conversion de texte en image récemment publiés, tels que DALL-E 2, Diffusion stableet À mi-parcours en permettant aux utilisateurs de mieux contrôler l’image du sujet, puis en contrôlant le modèle de diffusion à l’aide d’entrées textuelles.

DreamBooth peut également afficher le sujet sous différents angles de caméra avec seulement quelques photos d’entrée. L’intelligence artificielle (IA) peut prévoir les qualités du sujet et les synthétiser dans une navigation guidée par texte même si les photos d’entrée ne donnent pas de données sur le sujet sous différents points de vue.

Ce modèle peut également synthétiser les photographies pour créer d’autres ambiances, accessoires ou changements de couleur à l’aide d’indices de langage. Grâce à ces fonctionnalités, DreamBooth Google AI offre aux utilisateurs encore plus de personnalisation et de liberté créative.

L’article de DreamBooth “DreamBooth : affiner les modèles de diffusion texte-image pour la génération axée sur le sujet” prétend qu’ils fournissent un problème et une approche nouveaux:

- La génération axée sur le sujet est un nouveau problème.

Compte tenu de quelques images prises à la hâte du sujet, l’objectif est de créer de nouvelles représentations du sujet dans divers contextes tout en préservant une haute fidélité à ses caractéristiques visuelles fondamentales.

Applications de Google IA DreamBooth

Les principales applications Google DreamBooth AI sont les suivantes :

- Recontextualisation

- Rendus d’art

- Manipulation d’expressions

- Nouvelle synthèse de vue

- Accessoirisation

- Modification de propriété

Êtes-vous prêt à vous séparer de PhotoShop ? Examinons-les de plus près à l’aide des images instructives créées par Nataniel Ruiz et l’équipe DreamBooth.

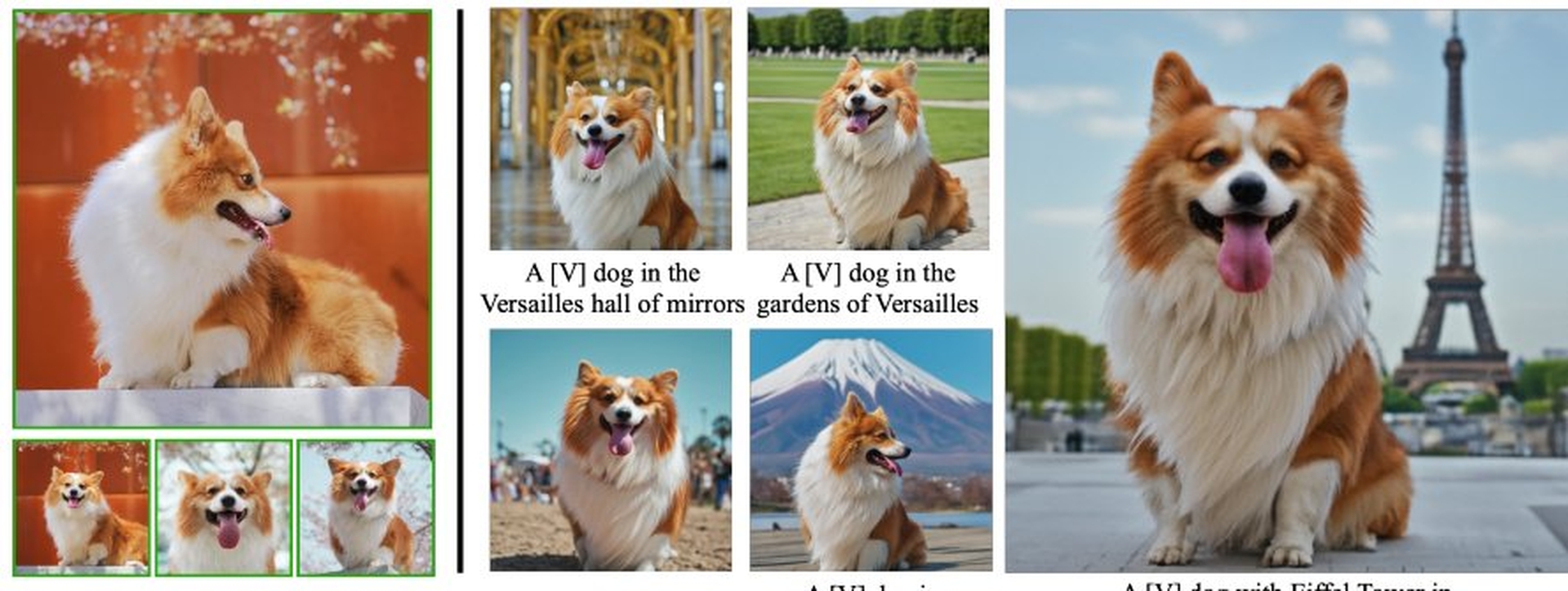

Recontextualisation

En fournissant une phrase comprenant l’identifiant unique et le nom de classe au modèle formé, DreamBooth AI peut créer des images uniques pour une certaine instance de sujet. Au lieu de modifier l’arrière-plan, DreamBooth AI peut produire le sujet dans des postures, des articulations et une structure de scène innovantes et inédites. des ombres et des reflets réalistes, ainsi que l’interaction du sujet avec les objets adjacents. Cela montre que leur stratégie offre plus qu’une simple extrapolation ou récupération d’informations pertinentes.

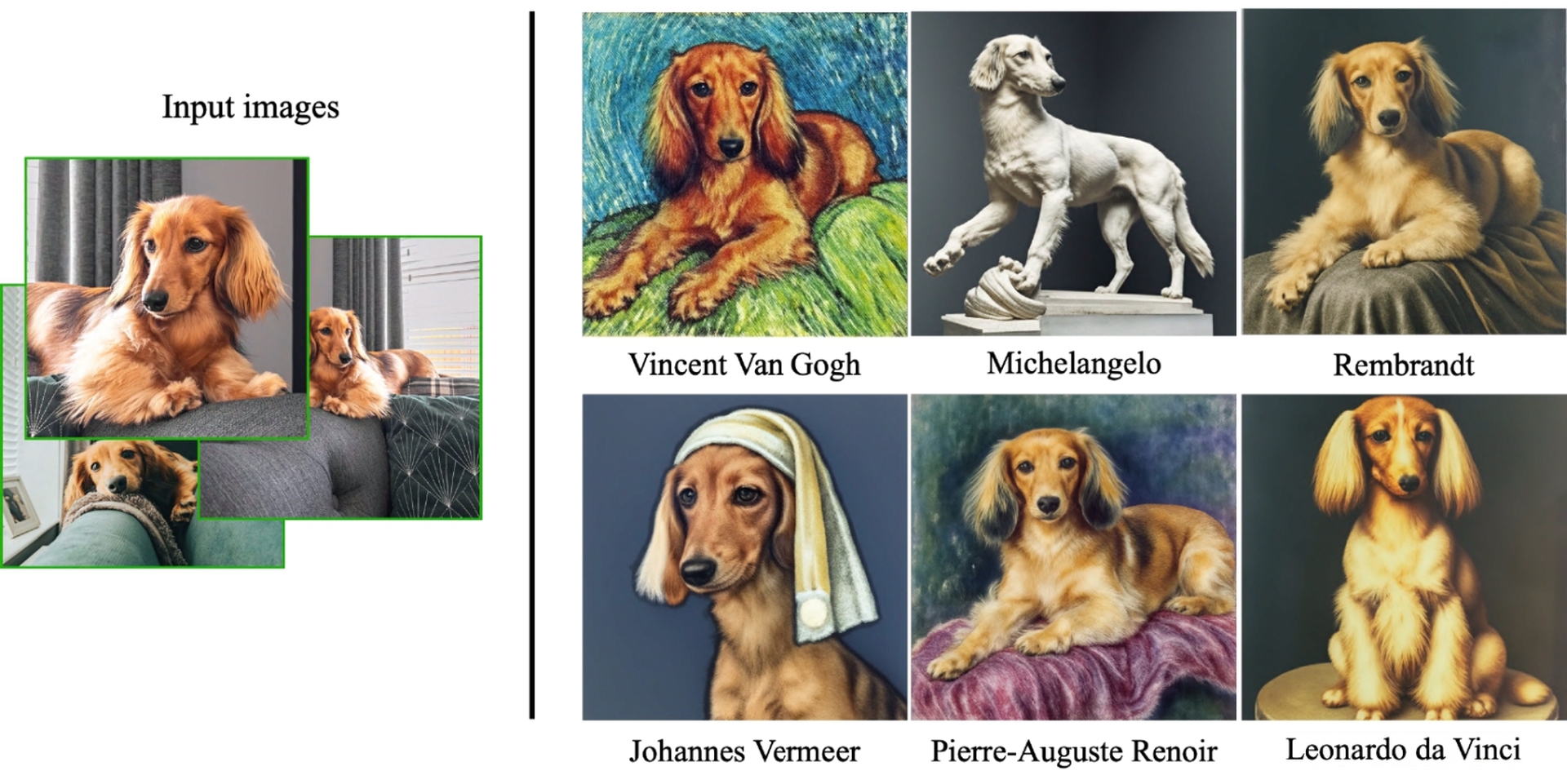

Rendus d’art

Si vous avez la possibilité de choisir entre “une statue d’un [V] [class noun] à la manière de [great sculptor]» et « une peinture d’un [V] [class noun] à la manière de [famous painter],” Lequel choisiriez-vous? À l’aide de DreamBooth AI, des représentations créatives originales peuvent être créées.

En particulier, cette tâche est différente du transfert de style, qui préserve la sémantique de la scène source tout en appliquant le style d’une autre image à la scène d’origine. En revanche, selon le style créatif, l’IA peut réaliser d’importants changements de scène avec des détails d’instance de sujet et la préservation de l’identité.

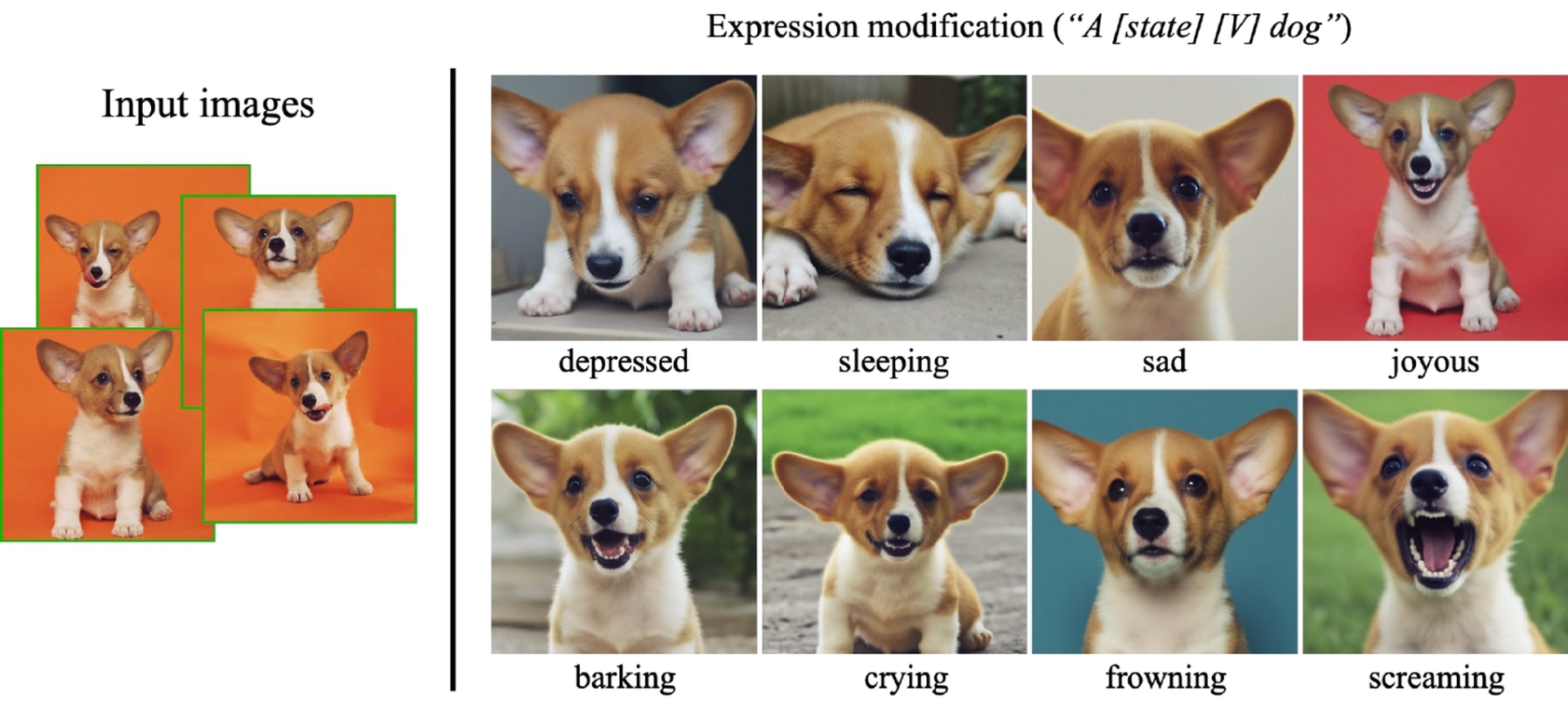

Manipulation d’expressions

Avec l’aide de la méthode de Google DreamBooth AI, de nouvelles images du sujet peuvent être produites avec des expressions faciales différentes de celles de l’ensemble d’images d’origine.

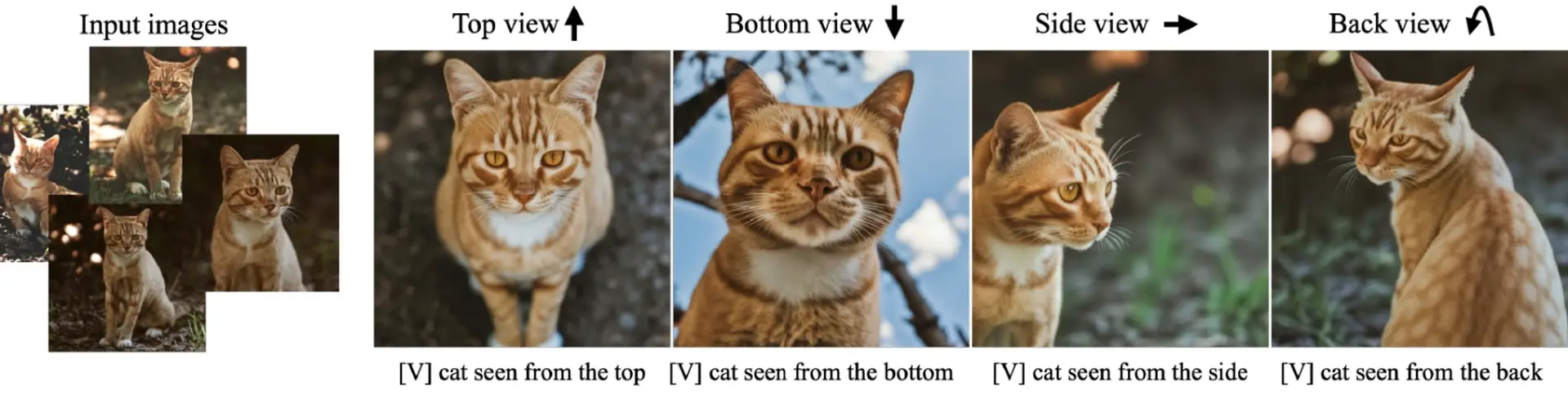

Nouvelle synthèse de vue

Google DreamBooth AI peut représenter le sujet sous un certain nombre de perspectives uniques. Par exemple, DreamBooth AI peut produire de nouvelles images du même chat en utilisant différents angles de caméra, remplis de motifs de fourrure détaillés et fiables.

Bien que le modèle n’ait que quatre photographies frontales du chat, DreamBooth AI est capable de déduire des informations de la classe avant de créer ces points de vue créatifs, même s’il n’a jamais vu ce même chat de côté, d’en bas ou d’en haut.

Accessoirisation

L’aspect intrigant de la capacité de DreamBooth AI à embellir les objets provient de la forte composition préalable du modèle de génération. A titre d’illustration, le modèle est invité avec une phrase de la forme “un [V] [class noun] portant [accessory]”. Cela nous permet de fixer divers objets sur le chien de manière attrayante.

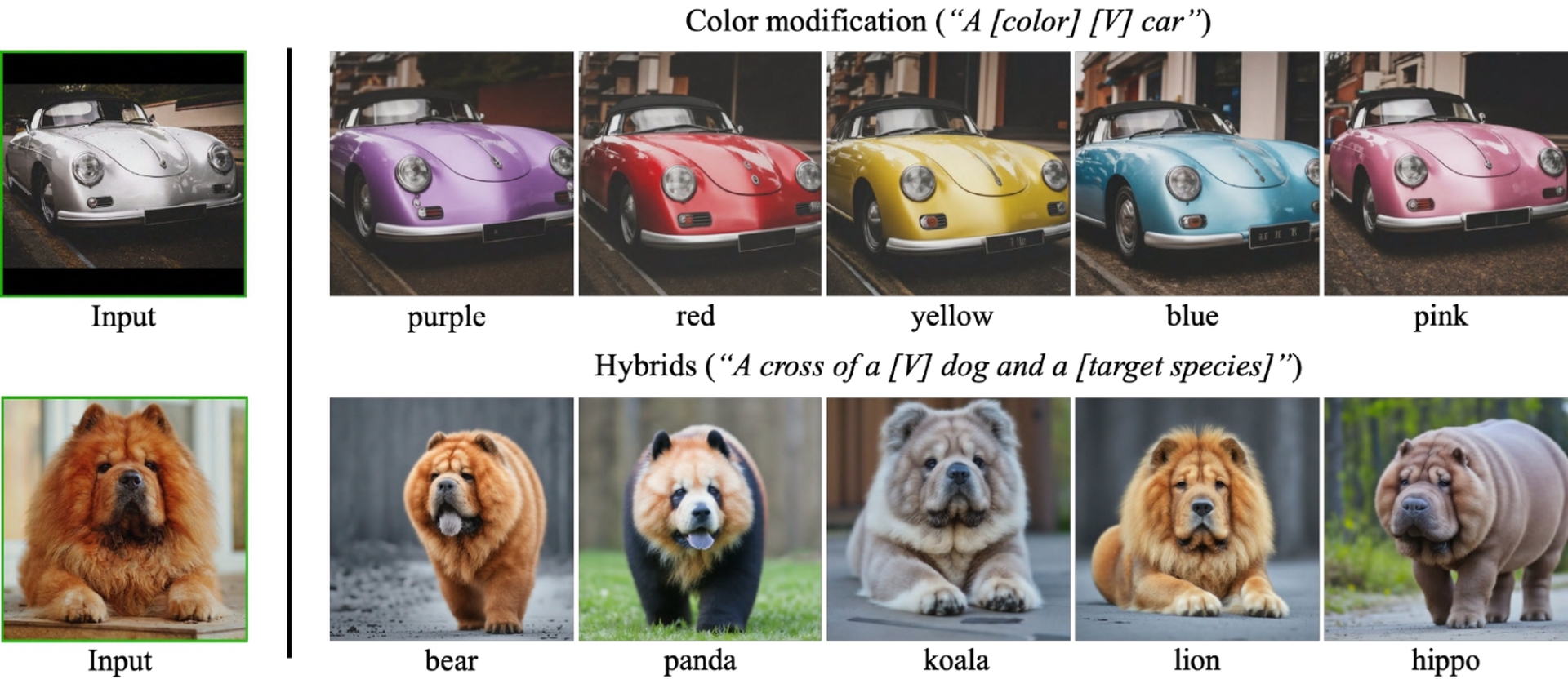

Modification de propriété

DreamBooth AI est capable de modifier les propriétés de l’instance du sujet. Un adjectif de couleur pourrait être utilisé dans la phrase d’exemple “un [color adjective] [V] [class noun]”. Cela pourrait entraîner des instances fraîches et vives du sujet. Il y a quelques exigences, mais ces caractéristiques expliquent également comment utiliser DreamBooth AI.

Vous utilisez l’IA Google DreamBooth ?

La technique DreamBooth AI prend en entrée un petit nombre de photographies (généralement 3 à 5 images suffisent) d’un sujet (par exemple, un chien particulier) et le nom de classe qui lui est associé (par exemple, “chien”). Il produit ensuite un modèle texte-image qui a été peaufiné et « personnalisé » et encode une identité unique pour le sujet. Pour synthétiser les sujets dans divers contextes, DreamBooth AI peut ensuite insérer l’identification distinctive lors de l’inférence dans diverses phrases. Étant donné trois à cinq images du sujet, vous pouvez ajuster une diffusion texte-image en deux étapes :

- Une invite de texte avec un code particulier et le nom de la classe à laquelle appartient le sujet (par exemple, “une image d’un [T] canine ») sera utilisé pour améliorer le modèle texte-image à basse résolution. De plus, ils utilisent une perte de préservation a priori spécifique à la classe, qui exploite la sémantique a priori du modèle sur la classe et l’encourage à générer une gamme d’exemples qui sont membres de la classe du sujet en mettant le nom de la classe dans l’invite de texte (par exemple , “une image d’un chien”).

- Nous obtenons une grande fidélité en ajustant les composants de super-résolution à l’aide de paires de photographies basse et haute résolution de notre ensemble d’images d’entrée.

Le premier Dreambooth a été réalisé avec Imagenparadigme du texte à l’image. Le modèle et les poids d’Imagen ne sont cependant pas disponibles. Cependant, à l’aide de quelques exemples, Dreambooth sur Stable Diffusion permet aux utilisateurs d’ajuster un modèle texte-image.

Comment utiliser Google Dreambooth AI sur Stable Diffusion ?

Pour utiliser DreamBooth AI sur Stable Diffusion, suivez les étapes suivantes :

- Suivez les instructions de configuration du référentiel Textual Inversion ou du référentiel Stable Diffusion d’origine pour configurer votre environnement LDM.

- Pour affiner un modèle de diffusion stable, vous devez recevoir les modèles de diffusion stables pré-formés et respecter leurs instructions. Vous pouvez télécharger des poids à partir de ÉtreindreVisage.

- Préparez une série d’images pour la régularisation comme requis par la méthode de réglage fin de Dreambooth.

- Vous pouvez vous entraîner en utilisant la commande suivante :

1 2 3 4 5 6 sept 8 | python main.py --base configs/stable-diffusion/v1-finetune_unfrozen.yaml -t --actual_resume /path/to/original/stable-diffusion/sd-v1-4-full-ema.ckpt -n <job name> --gpus 0, --data_root /root/to/training/images --reg_data_root /root/to/regularization/images --class_word <xxx> |

Génération

Après la formation, la commande peut être utilisée pour obtenir des exemples personnalisés.

1 2 3 4 5 6 sept | python scripts/stable_txt2img.py --ddim_eta 0.0 --n_samples 8 --n_iter 1 --scale 10.0 --ddim_steps 100 --ckpt /path/to/saved/checkpoint/from/training --prompt "photo of a sks <class>" |

En particulier, class> est le mot de classe – mot de classe pour la formation – et sks est l’identifiant (qui, si vous souhaitez le modifier, doit être remplacé par votre choix). Pour plus d’informations, visitez le Page GitHub pour DreamBooth Stable Diffusion.

Limites de l’IA Dreambooth

Les limitations de DreamBooth AI sont les suivantes :

- Dérive linguistique

- Sur-ajustement

- Perte de conservation

Examinons-les de plus près.

Dérive linguistique

La production d’itérations dans le sujet avec un degré élevé de détails est gênée par l’invite de commande. DreamBooth peut changer le contexte du sujet, mais il y a des problèmes avec le cadre si le modèle souhaite changer le sujet réel.

Sur-ajustement

Un autre problème est lorsque l’image de sortie est surajustée sur l’image d’origine. Le sujet peut ne pas être évalué ou peut être combiné avec le contexte des images téléchargées s’il n’y a pas assez de photos d’entrée. Cela se produit également lorsqu’un contexte pour une génération impaire est demandé.

Perte de conservation

L’incapacité à synthétiser des images de sujets plus rares ou plus complexes ainsi qu’une fidélité sujet variable, qui peut entraîner des changements hallucinogènes et des qualités discontinues, sont d’autres limitations. Le contexte d’entrée est fréquemment inclus dans le sujet des images d’entrée.

Impact sociétal de l’IA

L’objectif du projet DreamBooth est de fournir aux utilisateurs un outil pratique pour synthétiser des sujets personnels (animaux, objets) dans une variété de contextes. Bien que les algorithmes standard de conversion de texte en image puissent être orientés vers des aspects spécifiques lors de la synthèse d’images à partir de mots, cela aide l’utilisateur à mieux recréer les sujets qu’il a choisis. Cependant, des parties malveillantes peuvent essayer de tromper les utilisateurs en utilisant des images similaires. Diverses méthodes de modèles génératifs ou techniques de modification de contenu présentent ce problème omniprésent.

Conclusion

La majorité des modèles texte-image ont besoin de millions de paramètres et de bibliothèques pour créer des sorties à partir d’une seule entrée de texte. DreamBooth permet aux utilisateurs d’obtenir plus facilement du contenu et de l’utiliser en ayant simplement besoin de la saisie de trois à cinq images de sujet avec une toile de fond écrite.

Les qualités distinctives du sujet peuvent donc être préservées tandis que le modèle formé réutilise les aspects matérialistes du sujet appris à partir des images pour les reproduire dans d’autres contextes et points de vue. La plupart des algorithmes de conversion de texte en image reposent sur certains mots-clés et peuvent donner la priorité à des attributs spécifiques lors de l’affichage d’images. Les utilisateurs de DreamBooth peuvent produire des résultats photoréalistes en voyant la personne choisie dans un environnement ou un scénario unique. Alors, arrêtez d’attendre maintenant. Essayez-le maintenant!

Nous espérons que vous avez apprécié cet article sur l’utilisation de Google Dreambooth AI sur Stable Diffusion. Si tel est le cas, nous sommes sûrs que vous apprécierez également la lecture de certains de nos autres articles, tels que DALL-E 2 a introduit l’outpainting : l’IA imagine au-delà des frontières, ou Stable Diffusion AI art generator : Prompts, examples, and how to run.

Source: Comment utiliser Google Dreambooth AI sur Stable Diffusion ?