Le domaine de l’IA a connu un grand changement avec l’introduction de CogVideoX-5B. Ce modèle d’IA, développé par des chercheurs de l’Université Tsinghua et de Zhipu AI, pourrait changer la façon dont les vidéos sont réalisées et le paysage du contenu numérique. Qu’est-ce que CogVideoX-5B et pourquoi est-il si populaire ?

CogVideoX-5B est différent car il est accessible et possède des capacités impressionnantes. Ce modèle peut créer des vidéos de haute qualité d’une durée maximale de six secondes à partir d’un simple texte. Cela a de grandes implications. Le modèle est open source, les développeurs du monde entier peuvent donc l’utiliser. Cela permet à tout le monde de créer plus facilement des vidéos.

CogVideoX-5B est également disponible.https://t.co/e3bNKp3adp

Un chaton blanc tout doux, avec un ruban rose noué autour du cou, joue sur un coussin près d’une fenêtre ensoleillée, sa fourrure douce brille à la lumière. La scène commence à une légère distance, puis s’approche progressivement tandis que le chaton bat un petit coup… pic.twitter.com/1x1y3mqFA6

– 布留川英一 / Hidekazu Furukawa (@npaka123) 28 août 2024

Qu’est-ce qui le fait fonctionner à l’intérieur du CogVideoX-5B ?

Le CogVideoX-5B modèle a 5 milliards de paramètres. Le modèle peut produire des vidéos à Résolution 720×480 et 8 images par secondeCe modèle n’est pas le meilleur, mais il est quand même bon, surtout parce que c’est open source.

Le succès du CogVideoX-5B est dû à plusieurs innovations techniques. Le modèle utilise un Autoencodeur variationnel 3D (VAE) pour compresser les données vidéo, facilitant ainsi leur génération des résultats de haute qualité. Il utilise également un «transformateur expert” avec adaptatif Norme de couchece qui permet au modèle d’interpréter le texte avec plus de nuances, ce qui donne lieu à des vidéos plus précises et plus cohérentes.

La décision de publier CogVideoX-5B en open source est une avancée majeure pour l’IA. Les chercheurs de Université de Tsinghua et IA Zhipu Les développeurs ont rendu public leur code et le poids de leurs modèles, facilitant ainsi l’utilisation de technologies avancées de génération de vidéos. Cela signifie que les développeurs peuvent désormais expérimenter du contenu vidéo généré par l’IA. Cette approche open source pourrait donner naissance à de nouveaux outils et applications dans de nombreux secteurs.

Créé par CogVideoX-5B ! pic.twitter.com/Y22zcg8fBA

— F-AI (@faiAI0) 28 août 2024

CogVideoX-5B : comment le comparer et qui l’a créé

Le CogVideoX-5B n’est pas le premier modèle de conversion de texte en vidéo, mais il s’avère être l’un des plus influents. Il a surpassé des concurrents comme VideoCrafter-2.0 et OpenSora. Cela est dû aux nouvelles techniques utilisées par les développeurs. Des chercheurs de l’Université Tsinghua et IA Zhipu ont créé un outil qui pourrait changer la façon dont le contenu numérique est produit et consommé.

Comment démarrer avec CogVideoX-5B

Vous pouvez utiliser et expérimenter le modèle CogVideoX-5B gratuitement. Voici un guide simple pour commencer :

- Visitez le dépôt GitHub:Le code CogVideoX-5B et les poids du modèle sont activés GitHubTéléchargez-les sur votre ordinateur.

- Configurez votre environnement: Assurez-vous de disposer des bons outils pour exécuter le modèle. Cela peut inclure des versions spécifiques de Python et des bibliothèques comme Torche PyTorch.

- Exécuter le modèle:Saisissez des invites de texte et générez des vidéos à l’aide des instructions du référentiel.

- Expérimenter et innover:Une fois que vous connaissez les bases, essayez différentes invites de texte pour voir ce que le modèle peut faire.

CogVideoX-5B (txt2vid) a été ajouté au module complémentaire gratuit de Blender, Pallaidium : #b3d pic.twitter.com/ynBupL2TKT

— tintwotin (@tintwotin) 27 août 2024

Comment essayer CogVideoX-5B en ligne

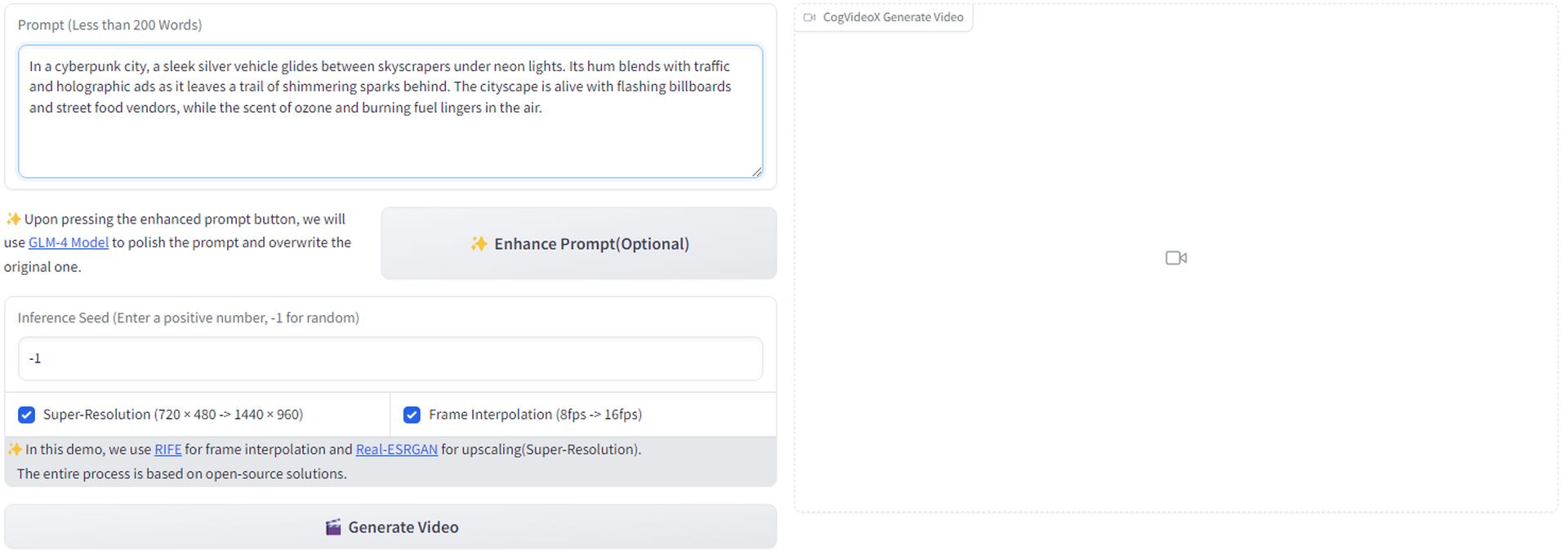

Si vous ne souhaitez pas télécharger CogVideoX-5B, vous pouvez l’essayer en ligne via Hugging Face. Voici un guide sur la façon d’utiliser la démo :

- Visitez la page de démonstration:Aller à la CogVideoX-5B Face à l’espace étreignant.

- Entrez votre invite de texte: Dans le “RapideDans la case “, décrivez la vidéo que vous souhaitez générer. Limitez-la à moins de 200 mots pour obtenir les meilleurs résultats.

- Améliorez votre message (facultatif):Cliquez sur « Améliorer l’invite » pour peaufiner votre saisie et écraser l’invite d’origine.

- Définir une graine d’inférence (facultatif): Pour contrôler le caractère aléatoire de la génération vidéo, entrez un nombre positif dans la case « Inference Seed ». Si vous préférez une valeur aléatoire, laissez la valeur telle quelle

-1.

- Activer des fonctionnalités supplémentaires (facultatif):

- Super-Résolution: Sélectionnez cette case pour mettre à l’échelle la vidéo de 720 × 480 à 1 440 × 960.

- Interpolation de trame:Activez cette option pour améliorer la sortie vidéo en augmentant les images par seconde (de 8 FPS à 16 FPS).

- Générez votre vidéo:Lorsque vous avez terminé, cliquez sur « Générer une vidéo ». Le modèle créera une courte vidéo en fonction de vos instructions.

- Revoir la vidéo:Une fois générée, prévisualisez la vidéo sur la page. Ajustez les entrées et réessayez pour obtenir le résultat souhaité.

CogVideoX-5B et produits similaires

Le CogVideoX-5B est un autre modèle d’IA qui change les possibilités en matière de création de contenu numérique. Parmi les autres modèles notables, citons les outils de génération vidéo de Runway, Luma AI, VidéoCrafter2et Pika Labs. Chaque modèle a ses points forts, mais la nouvelle IA est open source, ce qui la rend plus facile à utiliser et permet à davantage de personnes de contribuer à son développement.

Cette entreprise représente une avancée importante dans le domaine de la vidéo générée par l’IA. Son approche open source facilite son utilisation pour tous et l’aide à continuer de s’améliorer. À mesure que de plus en plus de personnes commenceront à l’utiliser, la création de vidéos deviendra plus diversifiée, dynamique et accessible.

Crédits de l’image en vedette : CogVideoX

Source: Comment CogVideoX-5B va bouleverser à jamais la création vidéo